Neste ano, vimos um número vertiginoso de avanços no campo de Inteligência Artificial (IA) Generativa, desde sistemas que podem criar vídeos a partir de apenas algumas palavras até modelos que podem gerar áudio baseados em trechos de uma música.

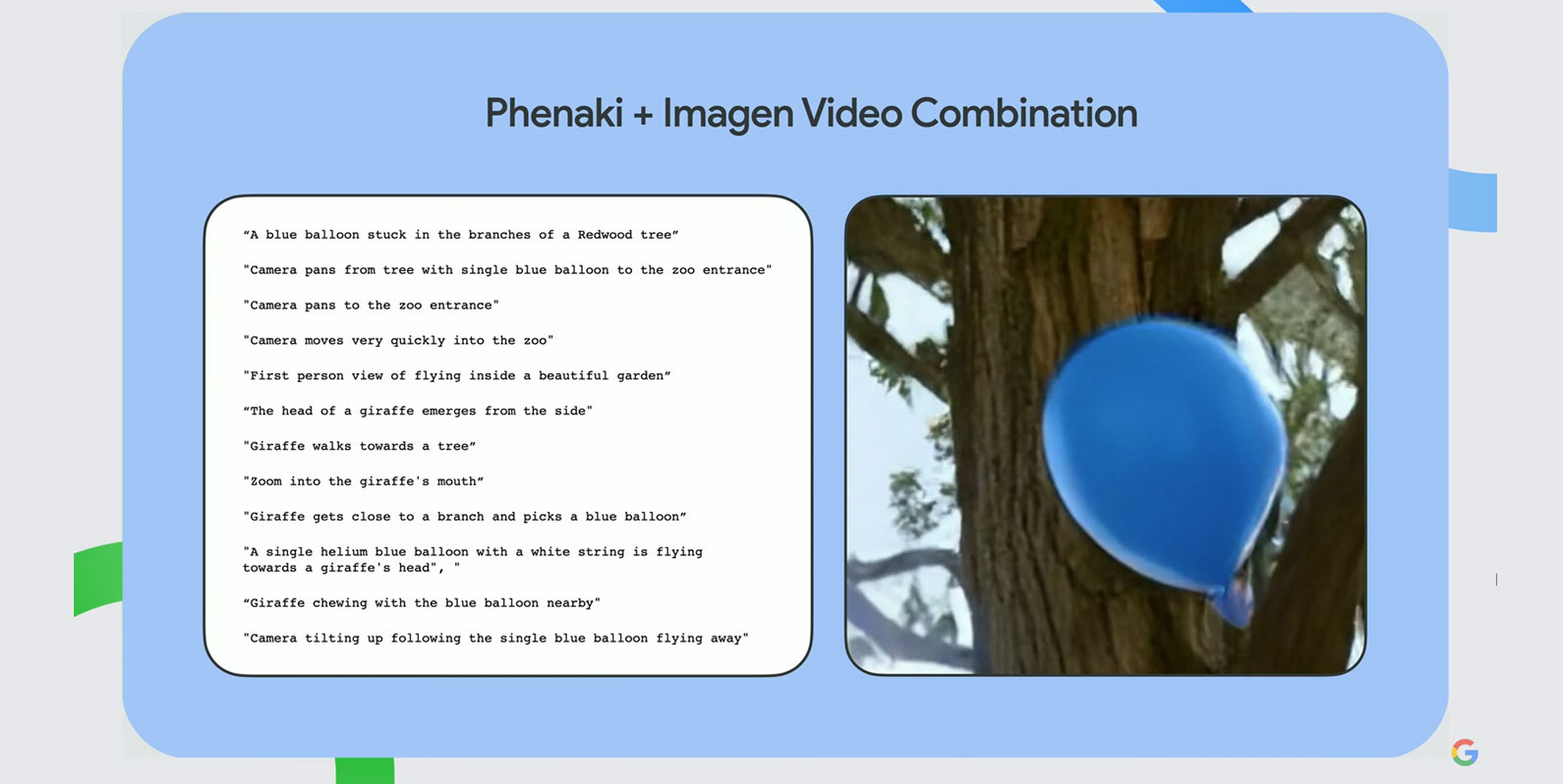

No começo de novembro, o Google realizou um evento sobre IA em seus escritórios novinhos em folha perto do rio Hudson, em Manhattan (EUA). A correspondente aqui fez uma visita para ver o que estava acontecendo. Seguindo as tendências atuais, o Google anunciou uma série de avanços no setor de IA Generativa, incluindo um sistema que combina seus dois modelos de texto para vídeo, Phenaki e Imagen. O Phenaki permite gerar vídeos a partir de uma série de linhas de texto que funcionam como uma espécie de roteiro, enquanto que o Imagen aumenta a resolução dos vídeos.

Mas esses modelos ainda estão longe de serem lançados para uso do público em geral. Eles ainda possuem alguns problemas graves, como a possibilidade de gerar conteúdo violento, sexista, racista ou que viole direitos autorais, isto tudo devido à natureza dos dados usados para treinamento, os quais em sua maioria são apenas informações coletadas da Internet. Um pesquisador que trabalha para o Google me disse que estes modelos ainda estavam em seus estágios iniciais e que muitas “estrelas teriam que se alinhar” antes que eles pudessem ser usados no mercado tecnológico. É uma pesquisa impressionante no ramo da IA, mas também ainda não está claro como o Google poderia monetizar estas tecnologias.

Algo que poderia ter um impacto em um prazo menor no mundo real é o novo projeto do Google para desenvolver um “modelo universal de fala” treinado em mais de 400 idiomas, disse Zoubin Ghahramani, vice-presidente de pesquisa do Google AI, no evento. A empresa não deu muitos detalhes, porém disse que publicará um artigo nos próximos meses.

Se este projeto der certo, isto representará um avanço significativo para as funcionalidades de grandes modelos de linguagem, conhecidos como LLMs. Por exemplo, o modelo BLOOM da startup de IA Hugging Face foi treinado em 46 idiomas, e a Meta tem trabalhado em sistemas que consigam traduzir centenas de idiomas em tempo real. Com o modelo recebendo mais idiomas para seus dados de treinamento, o Google poderá oferecer seus serviços para ainda mais pessoas. A incorporação de centenas de idiomas em um modelo de IA pode permitir que o Google ofereça traduções ou legendas mais precisas no YouTube ou aprimore sua ferramenta de pesquisa para fornecer resultados melhores em mais idiomas.

Durante minha viagem pela Costa Leste dos Estados Unidos, conversei com executivos de alto escalão de alguns dos maiores laboratórios de IA do mundo para ouvir a opinião deles sobre quais seriam os próximos passos do setor no próximo ano. Eis o que eles tinham a dizer:

Douglas Eck, cientista-chefe da Google Research e diretor de pesquisa da Google Brain, a equipe de pesquisa de deep learning da empresa

O próximo avanço provavelmente virá de sistemas multimodais de IA, os quais possuem múltiplas capacidades sensoriais, como a habilidade de usar visão e áudio computacional para interpretar informações, disse Eck. Depois, a grande novidade será descobrir como construir modelos de linguagem dentro de outros modelos de IA à medida que eles descobrem o mundo. Isto poderia, por exemplo, ajudar os robôs a assimilarem seus arredores por meio de comandos de voz e dicas visuais e linguísticas.

Yann LeCun, cientista-chefe de IA da Meta

A IA Generativa ficará cada vez melhor, disse LeCun: “Teremos maneiras melhores de especificar o que queremos deles”. Atualmente, os modelos apenas respondem a solicitações, mas “no momento, é muito difícil controlar o que o sistema de geração de texto fará”, ele acrescentou. No futuro, ele espera que “existam maneiras de mudar um pouco a arquitetura do sistema para que haja algum nível de planejamento mais deliberado”.

Raia Hadsell, diretora de pesquisa da DeepMind

Hadsell também estava entusiasmada com os sistemas multimodais de IA Generativa, os quais combinam áudio, linguagem e visão. Ao adicionar reinforcement learning no pacote, que permite que os modelos de IA treinem a eles mesmos por tentativa e erro, talvez possamos ver sistemas com “a capacidade de explorar, ter autonomia e interagir com os ambientes”, disse Hadsell.

Um aprendizado ainda mais profundo

O que as demissões em massa do Twitter significam para seus funcionários do setor de IA

Conforme informamos no começo de novembro, o Twitter pode ter perdido mais de um milhão de usuários desde que Elon Musk assumiu. A empresa Bot Sentinel, que rastreia comportamentos duvidosos ou suspeitos no Twitter analisando mais de 3,1 milhões de contas e suas atividades diariamente, acredita que cerca de 877.000 contas foram desativadas e outras 497.000 foram suspensas entre 27 de outubro e 1º de novembro. Isso é mais que o dobro do número habitual.

Para mim, está claro por que isso está acontecendo. Os usuários estão acreditando que a plataforma vai se tornar um lugar menos divertido para passar o tempo. Isto está ocorrendo em parte porque viram o Musk demitir pessoas que trabalhavam para garantir que a plataforma fosse segura, incluindo toda a equipe de ética em IA do Twitter. É provável que o Musk se arrependa. A empresa já está recontratando engenheiros e gerentes de produto para 13 cargos relacionados a machine learning, incluindo funções envolvidas com os setores de privacidade, manipulação da plataforma, gestão e defesa dos usuários on-line contra o terrorismo, extremismo violento e ofensa coordenada. Mas apenas conseguimos imaginar o dano que já foi causado, especialmente com as iminentes eleições de meio de mandato nos EUA.

Um exemplo inquietante: a equipe de ética da IA, liderada pelo pioneiro da ética em IA aplicada, Rumman Chowdhury, estava realizando façanhas bem impressionantes, tal qual dar acesso para pessoas de fora da empresa a seus conjuntos de dados para encontrar vieses duvidosos, com o intuito de controlar os efeitos colaterais mais tóxicos dos algoritmos de moderação de conteúdo do Twitter. Como escrevi no começo de novembro, os especialistas em ética da IA já enfrentam muita ignorância e resistência quanto ao seu trabalho, o que pode levá-los à síndrome de burnout. Aqueles que continuaram no Twitter enfrentarão uma pressão para corrigir os mesmos problemas, mas com muito menos recursos do que antes. Não vai ser nada agradável. E enquanto a economia global oscila à beira de uma recessão, é um sinal realmente preocupante que executivos de alto escalão como o Musk pensem que a ética da IA, um campo que trabalha para garantir que os sistemas de IA sejam justos e seguros, seja a primeira coisa que valha a pena eliminar.

Bits e Bytes

– Esta ferramenta permite que qualquer pessoa descubra o enviesamento nos geradores de imagem por IA

Uma ferramenta criada pela pesquisadora da Hugging Face, Sasha Luccioni, permite que qualquer pessoa teste como o sistema Stable Diffusion de geração de imagem baseado em texto pode produzir resultados tendenciosos para certas combinações de palavras. (Vice)

– Os algoritmos administram silenciosamente a cidade de Washington, D.C. (EUA) — e talvez até mesmo sua cidade natal

Um novo relatório do Electronic Privacy Information Center descobriu que Washington, D.C., usa algoritmos em 20 órgãos municipais, sendo mais de um terço relacionado ao policiamento ou à justiça criminal. (Wired)

– A Meta faz enovelamento de proteínas

Seguindo os passos da DeepMind para aplicar IA à biologia, a Meta divulgou uma IA que revela as estruturas de centenas de milhões das proteínas menos compreendidas pela ciência. A empresa diz que, com 600 milhões de estruturas, seu modelo é três vezes maior do que qualquer outro anterior. (Meta)