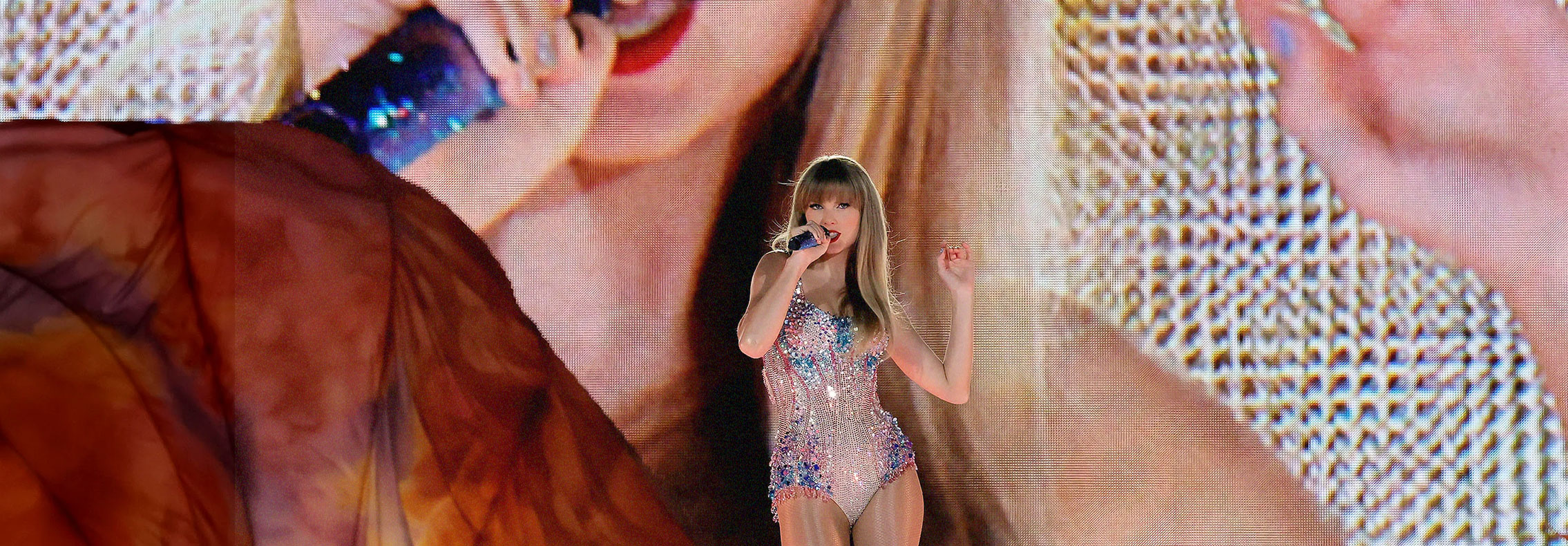

Oi, Taylor.

Só posso imaginar como você deve estar se sentindo depois da viralização de vídeos deepfake com conteúdo sexualmente explícito no X, antigo Twitter. Enojada. Angustiada, talvez. Até mesmo humilhada.

Lamento muito que isso esteja acontecendo com você. Ninguém merece ter sua imagem explorada dessa forma. Mas se você ainda não está, peço que fique furiosa.

Furiosa por isso estar acontecendo com você e com tantas outras mulheres e pessoas marginalizadas em todo o mundo. Furiosa com o fato de nossas leis atuais serem lamentavelmente ineptas para nos proteger de violações como essa. Furiosa com o fato de os homens (porque, convenhamos, são principalmente os homens que estão fazendo isso) poderem nos violar de maneira tão íntima e saírem ilesos e sem serem identificados. Furiosa com o fato das empresas que permitem que esse material seja criado e compartilhado amplamente também não sofrem nenhuma consequência e podem lucrar com o uso tão horrendo de sua tecnologia.

A pornografia deepfake existe há anos, mas sua última encarnação é a pior de todas. A Inteligência Artificial generativa tornou ridiculamente fácil e barato criar deepfakes realistas. E quase todos os deepfakes são feitos para pornografia. Apenas uma imagem retirada da mídia social é suficiente para gerar algo aceitável. Qualquer pessoa que já tenha postado ou tido uma foto sua publicada online é um alvo fácil.

Primeiro, as más notícias. No momento, não temos boas maneiras de combater isso. Acabei de publicar um artigo sobre três maneiras de combater a pornografia deepfake não consensual, que incluem marcas d’água e ferramentas de envenenamento de dados. Mas a realidade é que não existe uma solução técnica perfeita para esse problema. As soluções que temos ainda são experimentais e não foram adotadas amplamente pelo setor de tecnologia, o que limita seu poder.

Até o momento, o setor de tecnologia não está disposto ou não está motivado a fazer alterações que impeçam que esse material seja criado com suas ferramentas ou compartilhado em suas plataformas. É por isso que precisamos de regulamentação.

Pessoas com poder, como você, podem lutar com dinheiro e advogados. Mas mulheres de baixa renda, mulheres de cor, mulheres que fogem de parceiros abusivos, mulheres jornalistas e até mesmo crianças estão vendo sua imagem ser roubada e “pornificada”, sem nenhuma maneira de buscar justiça ou apoio. Qualquer um de seus fãs pode ser prejudicado por esse acontecimento.

A boa notícia é que o fato de isso ter acontecido com você significa que os políticos dos EUA estão ouvindo. Você tem uma oportunidade rara e um impulso para promover mudanças reais e práticas.

Sei que você luta pelo que é certo e não tem medo de se manifestar quando vê uma injustiça. Haverá um intenso lobby contra quaisquer regras que afetem as empresas de tecnologia. Mas você tem uma plataforma e o poder de convencer os legisladores de todas as áreas de que as regras para combater esses tipos de deepfakes são uma necessidade. As empresas de tecnologia e os políticos precisam saber que os dias de hesitação acabaram. As pessoas que criam esses conteúdos precisam ser responsabilizadas.

Você já causou um terremoto de verdade. Vencer a luta contra os deepfakes não consensuais teria um impacto ainda mais abalador.