O outono de 2017 pode ser lembrado como o momento em que a Big Tech lançou a iniciativa de entrar, literalmente, nas nossas cabeças. Foi então que surgiram notícias da nova empresa de interface cerebral de Elon Musk, a Neuralink, que está trabalhando para descobrir como costurar milhares de eletrodos no cérebro das pessoas. Dias depois, o Facebook se juntou à busca, quando anunciou que seu misterioso grupo de inovadores, chamado Building 8, estava tentando construir um fone de ouvido ou uma bandana que permitiria às pessoas enviar mensagens de texto por meio do pensamento — em um ritmo de 100 palavras por minuto.

O objetivo da empresa era de construir uma interface viva-voz que qualquer pessoa pudesse usar na Realidade Virtual (RV). “E se você pudesse digitar diretamente do seu cérebro?” perguntou Regina Dugan, uma ex-oficial da DARPA que era então chefe da divisão de hardware do Building 8. “Parece impossível, mas está mais perto do que você imagina”.

Agora a resposta já está aqui, mas não está nem um pouco perto do que tínhamos imaginado. Quatro anos depois de anunciar um projeto “incrível” para construir uma interface de “fala silenciosa” usando tecnologia óptica para ler pensamentos, o Facebook está arquivando o projeto, dizendo que a leitura do cérebro dos usuários ainda está muito distante de ser uma realidade.

Em uma postagem em seu blog, o Facebook disse que está descontinuando o projeto e, em vez disso, se concentrará em um controlador de pulso experimental para RV que lê sinais musculares no braço. “Embora ainda acreditemos no potencial de longo prazo das tecnologias óticas [de interface cérebro-máquina] na cabeça, decidimos concentrar nossos esforços imediatos em um método de interface neural diferente com um caminho mais próximo do mercado”, disse a empresa.

O projeto de datilografia cerebral do Facebook o levou a um território desconhecido, incluindo o financiamento de cirurgias cerebrais em um hospital da Califórnia e a construção de capacetes de prototipagem capazes de enviar luz através do crânio. Mas também aos controversos debates sobre se as empresas de tecnologia devem ter acesso às informações privadas do nosso cérebro. No final das contas, porém, a empresa parece ter decidido que a pesquisa simplesmente não resultará em um produto no curto prazo.

“Temos muita experiência prática com essas tecnologias”, diz Mark Chevillet, o físico e neurocientista que até o ano passado chefiava o projeto, mas recentemente mudou de função para estudar como o Facebook lida com as eleições. “É por isso que podemos dizer, com segurança, que, como uma interface de consumidor, um dispositivo óptico de fala silenciosa montado em uma cabeça ainda está muito longe de ser produzido. Possivelmente mais longe ainda do que fomos capazes de prever”.

Leitura da mente

O motivo da moda em torno das interfaces cérebro-computador é que as empresas veem o software controlado pela mente como um grande avanço — tão importante quanto o mouse do computador, a interface gráfica do usuário ou a tela sensível ao toque. Além do mais, os pesquisadores já demonstraram que, se eles colocarem eletrodos diretamente no cérebro para acessar neurônios individuais, os resultados são impressionantes. Pacientes paralisados com tais “implantes” podem mover habilmente braços robóticos e jogar videogames ou digitar por meio do controle da mente.

O objetivo do Facebook era transformar essas descobertas em uma tecnologia de consumo que qualquer pessoa pudesse usar, o que prescindiria do uso de um capacete ou de um fone de ouvido que pudessem ser colocados e tirados. A empresa nunca teve a intenção de fazer um produto que precisasse de uma cirurgia cerebral, diz Chevillet. Dados os muitos problemas regulatórios desse gigante das redes sociais, o seu CEO, Mark Zuckerberg, disse uma vez que a última coisa que a empresa deveria fazer é abrir crânios. “Nem quero pensar nas audiências do Congresso sobre isso”, ele comentou brincando.

Na verdade, à medida que as interfaces cérebro-computador avançam, surgem novas e sérias preocupações. O que aconteceria se as grandes empresas de tecnologia pudessem conhecer os pensamentos das pessoas? No Chile, legisladores estão até considerando um projeto de lei de direitos humanos para proteger dados cerebrais, livre arbítrio e privacidade mental das garras das empresas de tecnologia. Dado o fraco histórico de privacidade do Facebook, a decisão de interromper esta pesquisa pode ter o benefício adicional de criar restrições para a empresa em meio às crescentes preocupações sobre “neurorights”, ou direitos neurológicos.

O projeto do Facebook tinha como objetivo criar, especificamente, um controlador cerebral que pudesse ser atrelado a suas ambições no campo da RV; já tinha realizado a compra do Oculus VR em 2014 por US$ 2 bilhões. Para chegar lá, a empresa adotou uma abordagem em duas frentes, diz Chevillet. Primeiro, ela precisava determinar se uma interface capaz de converter pensamento em fala era possível. Para isso, patrocinou pesquisas na Universidade da Califórnia (USCF), em São Francisco, onde um pesquisador chamado Edward Chang colocou eletrodos na superfície do cérebro dos participantes.

Enquanto os eletrodos implantados leem dados de neurônios individuais, esta técnica, chamada eletrocorticografia ou ECoG, mede grupos razoavelmente grandes de neurônios de forma simultânea. Chevillet admite que o Facebook esperava que também fosse possível detectar os sinais equivalentes de fora da cabeça.

A equipe da UCSF fez alguns progressos surpreendentes e relatou, no New England Journal of Medicine, que usou esses eletrodos para decodificar a fala em tempo real. O sujeito da pesquisa era um homem de 36 anos que recebeu o nome de “Bravo-1”. Após um derrame grave, ele tinha perdido a capacidade de formar palavras inteligíveis e só conseguia grunhir ou gemer. No relatório, o grupo de Chang afirma que, com os eletrodos na superfície de seu cérebro, o Bravo-1 foi capaz de formar frases em um computador a uma taxa de cerca de 15 palavras por minuto. A tecnologia permite a medição de sinais neurais na parte do córtex motor associada aos esforços do Bravo-1 para mover sua língua e trato vocal enquanto ele se imaginava falando.

Para chegar a esse resultado, a equipe de Chang pediu ao Bravo-1 para se imaginar dizendo uma das 50 palavras comuns quase 10.000 vezes, alimentando os sinais neurais do paciente para um modelo de deep learning. Depois de treinar o modelo para combinar palavras com sinais neurais, a equipe foi capaz de determinar corretamente a palavra que Bravo-1 estava pensando em dizer 40% das vezes (as chances de um resultado desse teriam sido cerca de 2%). Mesmo assim, suas frases estavam cheias de erros. “Olá, como vai?” poderia sair “Lá comer vai.”

Mas os cientistas melhoraram o desempenho adicionando um modelo de linguagem — um programa que determina quais sequências de palavras são mais prováveis em inglês. Isso aumentou a precisão para 75%. Com esta abordagem ciborgue, o sistema podia prever que a frase do Bravo-1 “Eu endireito minha enfermeira” na verdade significava “Eu gosto da minha enfermeira”.

Por mais notável que seja o resultado, há mais de 170.000 palavras em inglês e, portanto, o desempenho cairia quando aplicado a palavras fora do vocabulário restrito do Bravo-1. Isso significa que a técnica, embora possa ser útil como um auxílio médico, não está nem perto do que o Facebook tinha em mente. “Vemos aplicações em um futuro previsível em tecnologia assistiva clínica, mas não é aí que nosso negócio está”, diz Chevillet. “Estamos focados em aplicativos de consumo e há um longo caminho a percorrer para que isso ocorra.”

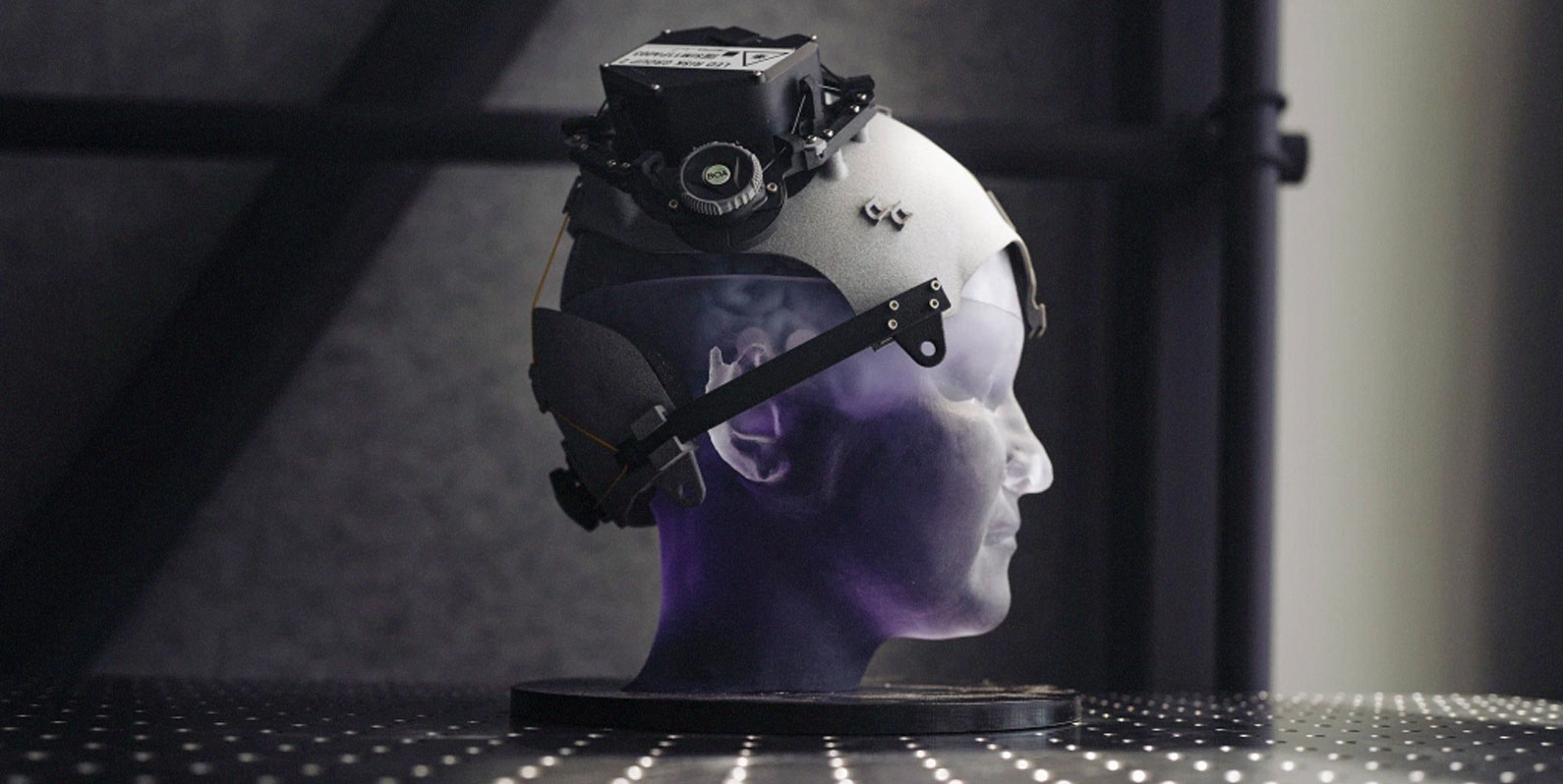

Equipamento desenvolvido pelo Facebook para tomografia óptica difusa, que usa luz para medir as mudanças de oxigênio no sangue dentro do cérebro. FACEBOOK

Falha óptica

A decisão do Facebook de abandonar a leitura cerebral não espantou os pesquisadores que estudam essas técnicas. “Não posso dizer que estou surpreso, porque eles deram a entender que estavam trabalhando no curto prazo e iriam reavaliar as coisas”, diz Marc Slutzky, um professor da Northwestern, cuja ex-aluna, Emily Mugler, foi uma das principais contratações do Facebook para esse projeto. “Falando por experiência própria, o objetivo de decodificar a fala é um grande desafio. Ainda estamos muito longe de um tipo de solução prática e abrangente”.

Ainda assim, Slutzky diz que o projeto da UCSF é um “próximo passo impressionante” que demonstra possibilidades notáveis e, também, alguns limites da ciência no campo da leitura do cérebro. Ele afirma que se os modelos de inteligência artificial pudessem ser treinados por mais tempo e no cérebro de mais do que apenas uma pessoa, eles poderiam melhorar rapidamente.

Enquanto a pesquisa da UCSF estava em andamento, o Facebook também pagava outros centros, como o Laboratório de Física Aplicada da Johns Hopkins, para descobrir como bombear luz através do crânio para ler neurônios de forma não invasiva. Muito parecido com a ressonância magnética, essas técnicas dependem da detecção da luz refletida para medir a quantidade de fluxo sanguíneo para as regiões do cérebro.

São essas técnicas ópticas que continuam sendo o maior obstáculo. Mesmo com as melhorias recentes, incluindo algumas feitas pelo Facebook, elas não são capazes de captar sinais neurais com resolução suficiente. Outro problema, diz Chevillet, é que as mudanças no sangue que esses métodos detectam atingem um pico em alguns segundos, logo após o disparo de um grupo de neurônios, tornando-o lento demais para controlar um computador.

“O abandono do Facebook não vai contra a tecnologia óptica — é uma avaliação das coisas para as quais eles estão tentando usá-la”, diz Bryan Johnson, CEO e fundador da Kernel, que este ano começou a comercializar um capacete que analisa o cérebro usando raios infravermelhos próximos. Ele diz que, como a ressonância magnética, essa tecnologia é melhor para medir estados cerebrais gerais, algo que ele acredita ter aplicações como a detecção de emoções ou de atenção. “O objetivo que eles têm é melhorar o controle, e essa tecnologia não se encaixa nele. Ele mede um sinal hemodinâmico, e esse sinal é lento”, diz Johnson.

O que vem depois?

O Facebook agora planeja se concentrar em uma tecnologia que adquiriu em setembro de 2019, quando comprou uma startup chamada CTRL-Labs por mais de US$ 500 milhões, uma de suas maiores aquisições públicas desde a Oculus. Essa empresa está desenvolvendo um dispositivo usado no pulso que captura sinais elétricos nos músculos de uma pessoa por meio de uma técnica conhecida como EMG. Ele pode detectar gestos ou descobrir qual dedo alguém está movendo.

Isso não é uma interface cerebral, mas pode ser uma maneira mais simples de interagir no mundo virtual que o Facebook está construindo com seus googles de RV. Imagine, por exemplo, puxar um arco em um jogo de aventura e, em seguida, lançar a flecha com um pequeno movimento nos dedos. De acordo com Krishna Shenoy, neurocientista da Stanford University que é consultora do CTRL-Labs, o dispositivo pode registrar a atividade elétrica nos músculos “em um nível extremamente detalhado” e pode capturar movimentos reais “de vários dedos e com poucas deslocações”.

Em sua postagem no blog, o Facebook disse que “faz sentido concentrar nossa atenção de curto prazo em interfaces neurais baseadas no pulso usando EMG, uma tecnologia comprovadamente viável que acreditamos ter um caminho de mercado em curto prazo para a entrada de Realidade Aumentada / Realidade Virtual”.

A empresa diz que agora planeja liberar o software que desenvolveu para decodificação cerebral e também fornecer acesso aos protótipos dos dispositivos, para que outros pesquisadores possam se beneficiar do trabalho realizado. “Nós já resolvemos os problemas principais: se seria viável decodificar a fala a partir da atividade cerebral e, então, se seria praticável decodificá-la com um dispositivo ótico portátil”, diz Chevillet.

“Acreditamos que será possível, eventualmente”.